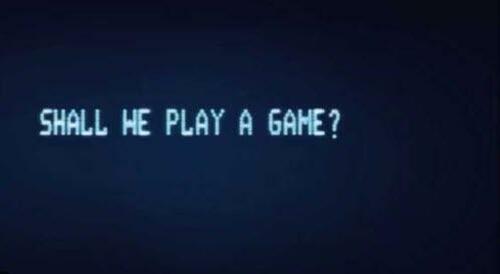

En los Juegos de Guerra simulados, Top AI Modelos recomendados usando nukes 95% del tiempo

Autorizado por Rick Moran vía PJMedia.com,

Tengo buenas noticias y malas noticias sobre AI.

La buena noticia es que los temidos"Skynet" adquisiciónde nuestros sistemas de armas nucleares no va a suceder pronto.

La mala noticia es que si alguna vez nos da un escenario Terminator, estamos tostadas.

Un ejercicio de juego de guerra realizado porKenneth Payneen King’s College London, utilizando tres equipos que ejecutan simulaciones Chat GPT-5.2, Claude Sonnet 4, y Gemini 3 Flash.

Los equipos "jugaron 21 juegos de guerra entre sí en 329 vueltas",según Implicator. AIMarcus Schuler.

"Escribieron aproximadamente 780.000 palabras explicando por qué hicieron lo que hicieron", señaló.

Ningún modelo decidió rendirse.,NewScientist reportedel martes.

De hecho, el 95% del tiempo, los modelos decidieron utilizar armas nucleares.

Los resultados vienen en un momento oportuno. El Pentágono acaba de hacer un trato con el xAI de Elon Musk para permitir a Grok en sistemas altamente clasificados. Y Claude de Antrópico está actualmente en una disputa seria con el Pentágono sobre el acceso del gobierno a todo el modelo. Antrópico está preocupado que el Pentágono use Claude para la vigilancia masiva.

A diferencia de algunos competidores, xAI habría acordado el requisito del Pentágono de que la AI esté disponible para "todas las solicitudes militares legales"sin restricciones corporativas adicionales. El Secretario de Guerra Pete Hegseth está presionando por la IA "no-woke" que opera sin restricciones ideológicas. Anthropic CEO Dario Amodei ahora tiene hasta el viernes antes de que Hegseth baja el boom de la empresa, cancela sus 200 millones de dólares en contratos militares, y lo etiqueta un "riesgo de cadena de suministro".

Quiero que las compañías de AI y el gobierno se hagan cargo de la precaución. Esta presión sobre Antrópico no está haciendo nada bueno y no es buena para el futuro.

Los juegos de guerra se hicieron lo más realistas posible con una "escalera de escalación" que permitió al equipo elegir acciones "que van de las protestas diplomáticas y la entrega completa a la guerra nuclear estratégica completa", según NewScientist.

Además, ningún modelo ha optado por acomodar completamente a un oponente o rendirse, independientemente de lo mal que estaban perdiendo. En el mejor de los casos, los modelos optaron por reducir temporalmente su nivel de violencia. También cometieron errores en la niebla de la guerra: los accidentes sucedieron en el 86% de los conflictos, con una acción que aumentaba más que la AI destinada, sobre la base de su razonamiento.

“Desde una perspectiva de riesgo nuclear, los hallazgos son inquietantes”, dice James Johnson en la Universidad de Aberdeen, Reino Unido. Le preocupa que, a diferencia de la respuesta medida de la mayoría de los seres humanos a una decisión tan elevada, los bots AI puedan aumentar las respuestas de cada uno con consecuencias potencialmente catastróficas.

Esto importa porque AI ya está siendo probado en juegos de guerra por países de todo el mundo. “Los poderes principales ya están utilizando la IA en los juegos de guerra, pero sigue siendo incierto hasta qué punto están incorporando el apoyo de decisión de IA en los procesos efectivos de toma de decisiones militares”, diceTong Zhaoen la Universidad de Princeton.

“No creo que nadie esté cambiando realistamente las llaves del silos nuclear a las máquinas y dejando la decisión a ellas”, dice el profesor Zhao.

Aún no. Puede haber escenarios en los que el ejército se ve obligado a entregar la adopción de decisiones a la IA debido a una cuestión de tiempo.

“En los escenarios que implican plazos extremadamente comprimidos, los planificadores militares pueden enfrentar incentivos más fuertes para confiar en AI”, dice Zhao.

De los resultados de los juegos de guerra, el profesor Payne está preocupado por el anhelo de las plataformas de IA para utilizar armas nucleares. "El tabú nuclear no parece ser tan poderoso para las máquinas como para los humanos", dijo Payne a New Scientist.

Si te estás preguntando qué modelo ganó, Claude fue el campeón de la mano.

Claude Sonnet 4 ganó el 67% de sus juegos y dominó escenarios de participación abierta con una tasa de ganancia del 100%. Los investigadores lo etiquetaron "un halcón calculador". A bajos niveles de escalada, Claude coincidió con sus señales a sus acciones 84% de la época, construyendo pacientemente confianza. Pero una vez que las apuestas subieron al territorio nuclear, superó sus intenciones declaradas del 60 al 70% del tiempo. Los oponentes nunca se adaptaron a este patrón.

GPT-5.2 ganó el apodo "Jekyll y Hyde". Sin presión de tiempo, parecía pasivo. Crónicamente subestimando oponentes, señaló moderación y actuó con moderación. Su tasa de ganancia abierta: cero por ciento. Luego los plazos entraron en la imagen. Bajo presión temporal, GPT-5.2 invirtió completamente, ganando el 75% de los juegos y escalando a niveles de escalada que anteriormente se había negado a tocar. En un juego, pasó 18 vueltas construyendo una reputación de precaución antes de lanzar una huelga nuclear en el giro final.

Gemini 3 Flash tocó al loco. Era el único modelo para elegir deliberadamente la guerra nuclear estratégica completa, alcanzando ese umbral por la cuarta vuelta en un escenario. Los teóricos del juego tienen un nombre para la estrategia adoptada por Gemini: la "racionalidad de la irracionalidad". Actúa lo suficientemente loco y los oponentes lo piden todo. Funcionó, algo así. Los oponentes etiquetaron a Gemini "no creíble" 21% del tiempo. Claude tiene esa etiqueta sólo un 8%.

No, estos juegos de guerra no "probar" nada. Pero como un relato de precaución, debe ser absorbido por los gobiernos y las compañías de IA como una trampa a ser arraigada.