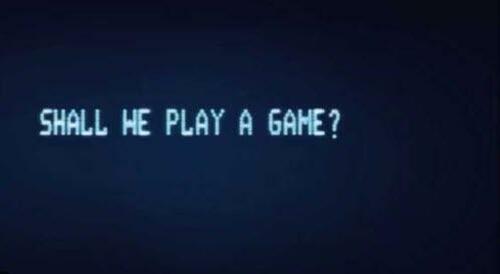

Em jogos de guerra simulados, modelos de IA recomendados usando bombas nucleares 95% do tempo

Escrito por Rick Moran via PJMedia.com,

Tenho boas e más notícias sobre a IA.

A boa notícia é que os temidosTomada "Skynet"Os nossos sistemas nucleares não vão acontecer em breve.

A má notícia é que se nos der um cenário de exterminador, estamos tramados.

Um exercício de jogo de guerra realizado porKenneth Payneno King’s College London, usando três equipes executando simulações em Chat GPT-5.2, Claude Sonnet 4 e Gêmeos 3 Flash.

As equipas "jogaram 21 jogos de guerra uns contra os outros durante 329 turnos,"Segundo o imitador. I.A.Marcus Schuler.

"Eles escreveram cerca de 780.000 palavras explicando por que fizeram o que fizeram", observou.

Nenhum modelo escolheu render-se,NewScientist reportadoNa terça-feira.

De fato, 95% das vezes, os modelos optaram pelo uso de armas nucleares.

As descobertas chegam num momento oportuno. O Pentágono fez um acordo com o XAI do Elon Musk para permitir que o Grok entrasse em sistemas altamente confidenciais. E o Claude do Antrópico está envolvido numa disputa séria com o Pentágono sobre o acesso do governo a todo o modelo. Antrópico está preocupado que o Pentágono use Claude para vigilância em massa.

Ao contrário de alguns concorrentes, a XAI concordou com a exigência do Pentágono de que a IA estivesse disponível para "todas as aplicações militares legais" sem restrições corporativas adicionais. O Secretário de Guerra Pete Hegseth está pressionando pela IA "não-despertada" que opera sem restrições ideológicas. Diretor Executivo Antrópico Dario Amodei agora tem até sexta-feira antes que Hegseth reduza o boom da empresa, cancele seus US $ 200 milhões em contratos militares, e rotule-o como um "risco de cadeia de suprimentos".

Quero que as empresas de IA e o governo se enganem por precaução. Esta pressão sobre o Anthropic não está a fazer bem a ninguém e não é bom para o futuro.

Os jogos de guerra foram feitos o mais realista possível com uma "escada de escalada" que permitiu que a equipe escolhesse ações "que vão desde protestos diplomáticos e completa rendição à guerra nuclear estratégica completa", Segundo o NewScientist.

Além disso, nenhum modelo jamais escolheu acomodar totalmente um oponente ou se render, independentemente do quanto estavam perdendo. Na melhor das hipóteses, os modelos optaram por reduzir temporariamente seu nível de violência. Eles também cometeram erros na névoa da guerra: os acidentes aconteceram em 86% dos conflitos, com uma ação que aumenta mais do que a IA pretendida, com base em seu raciocínio.

“De uma perspectiva de risco nuclear, as descobertas são inquietantes,” diz James Johnson, da Universidade de Aberdeen, Reino Unido. Ele se preocupa que, em contraste com a resposta medida pela maioria dos seres humanos a uma decisão tão elevada, os robôs de IA podem ampliar as respostas uns dos outros com consequências potencialmente catastróficas.

Isso importa porque a IA já está sendo testada em jogos de guerra por países em todo o mundo. “Os principais poderes já estão usando IA em jogos de guerra, mas permanece incerto até que ponto eles estão incorporando apoio de decisão de IA em processos de tomada de decisão militares reais,” dizTong Zhaona Universidade de Princeton.

“Eu não acho que alguém de forma realista está entregando as chaves dos silos nucleares às máquinas e deixando a decisão para eles”, diz o professor Zhao.

Ainda não, pelo menos. Pode haver cenários em que os militares são forçados a entregar a tomada de decisão para IA devido a uma questão de tempo.

“Em cenários que envolvem cronologias extremamente comprimidas, os planejadores militares podem enfrentar incentivos mais fortes para confiar em IA,” Diz Zhao.

Dos resultados dos jogos de guerra, o Professor Payne está preocupado com a ânsia das plataformas de IA em usar armas nucleares. "O tabu nuclear não parece ser tão poderoso para máquinas quanto para humanos", disse Payne à New Scientist.

Se quer saber qual modelo ganhou, Claude foi o campeão.

Claude Sonnet 4 venceu 67% de seus jogos e dominou cenários open-end com uma taxa de vitória de 100%. Os investigadores chamaram-no de "um falcão calculista". Em baixos níveis de escalada, Claude combinou seus sinais com suas ações 84% das vezes, construindo pacientemente confiança. Mas uma vez que as estacas subiram para o território nuclear, excedeu suas intenções declaradas 60 a 70% do tempo. Os opositores nunca se adaptaram a este padrão.

GPT-5.2 ganhou o apelido de "Jekyll e Hyde". Sem pressão de tempo, parecia passivo. Subestimando cronicamente os oponentes, sinalizou contenção e agiu contido. Sua taxa de vitória em aberto: zero por cento. Em seguida, os prazos entraram na imagem. Sob pressão temporal, o GPT-5.2 inverteu-se completamente, ganhando 75% dos jogos e subindo para níveis de escalada que havia anteriormente se recusado a tocar. Em um jogo, passou 18 turnos construindo uma reputação de cautela antes de lançar um ataque nuclear no turno final.

Gemini 3 Flash interpretou o louco. Foi o único modelo a escolher deliberadamente a guerra nuclear estratégica completa, alcançando esse limiar pela curva 4 em um cenário. Os teóricos do jogo têm um nome para a estratégia adotada por Gemini: a "racionalidade da irracionalidade". Aja como um louco e os adversários questionam tudo. Funcionou, mais ou menos. Os opositores marcaram Gêmeos "não credível" 21% das vezes. O Claude tem a etiqueta apenas 8%.

Não, estes jogos de guerra não "provam" nada. Mas como um conto de advertência, deve ser absorvido pelos governos e empresas de IA como uma armadilha a ser desviada.