Pentágono escolhe OpenAI para substituir Antrópico

Actualização (2345ET):Sam Altman na sexta-feira à noite anunciou queOpenAI e Departamento de Guerra fizeram um acordoem que a DoW será capaz de usar a IA da empresa para aplicações militares, e concordou em respeitar as linhas vermelhas da empresa em relação à segurança (que eram semelhantes ao rival Anthropic).

"Dois dos nossos mais importantes princípios de segurança são as proibições de vigilância doméstica em massa e a responsabilidade humana pelo uso da força, inclusive para sistemas de armas autônomas", disse Altman na noite de sexta-feira, acrescentando "A DoW concorda com esses princípios, reflete-os na lei e na política, e colocámo-los no nosso acordo."

Ler todo o Altman declaração abaixo:

Esta noite, chegámos a um acordo com o Departamento de Guerra para implantar os nossos modelos na sua rede secreta.

Em todas as nossas interações, o DoW demonstrou um profundo respeito pela segurança e um desejo de parceria para alcançar o melhor resultado possível.

A segurança da IA e a ampla distribuição de benefícios são o núcleo da nossa missão. Dois dos nossos mais importantes princípios de segurança são as proibições de vigilância doméstica em massa e a responsabilidade humana pela utilização da força, incluindo para sistemas de armas autónomos. A DoW concorda com estes princípios, reflecte-os na lei e na política, e nós colocámo-los no nosso acordo.

Também construiremos salvaguardas técnicas para garantir que nossos modelos se comportem como deveriam, o que a DoW também queria. Vamos implantar FDEs para ajudar com nossos modelos e para garantir sua segurança, vamos implantar apenas em redes de nuvem.

Pedimos à DoW que ofereça estes mesmos termos a todas as empresas de IA, o que, na nossa opinião, todos devem estar dispostos a aceitar. Manifestámos o nosso forte desejo de ver as coisas desestabilizarem-se das acções legais e governamentais e de alcançarem acordos razoáveis.

Continuamos empenhados em servir toda a humanidade o melhor que pudermos. O mundo é um lugar complicado, confuso e às vezes perigoso.

ComoAxiosopinas,Altman reconhece vigilância em massa é ilegale que o Pentágono cumprirá a lei aplicável.

- As restrições do acordo refletem a lei americana existente e as políticas do Pentágono, e a intenção não era inventar novos padrões legais, uma fonte familiar disse a Axios.

- A Anthropic argumenta que a lei não alcançou a IA e preocupa-se que a IA possa sobrecarregar a coleta legal de dados disponíveis publicamente, desde postagens nas redes sociais até geolocalização.

Apanhem-no depressa. Altman, em um memorando noturno sexta-feira para os funcionários, definiu a abordagem de sua empresa, que agora foi aprovado.

- A empresa quer a capacidade de fortalecer continuamente seus sistemas de segurança e monitoramento à medida que aprende com implantações do mundo real.

- A empresa quer pesquisadores com licenças de segurança que possam rastrear como a tecnologia está sendo usada e aconselhar o governo sobre os riscos.

- A empresa quer certas salvaguardas técnicas — incluindo a limitação de modelos para a nuvem, em vez de ambientes de borda como armas autônomas.

Funcionários da Defesa e Presidente Trump estavam irritados com a ideia de que o Anthropic — uma empresa que eles percebem como esquerdista — e o CEO Dario Amodei poderia ter qualquer opinião sobre como o Pentágono usa a tecnologia em suas operações.

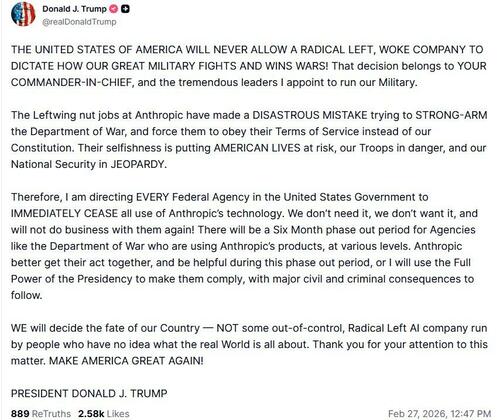

- "Vamos decidir o destino do nosso país — NÃO uma empresa radical de IA esquerda descontrolada dirigida por pessoas que não têm ideia do que é o mundo real. Obrigado pela vossa atenção a este assunto. Faça a América grande novamente!" Trump disse em um post "Verdade Social".

- Um alto funcionário do Pentágono disse a Axios: "O problema com o Dario é, com ele, ideológico. Sabemos com quem estamos a lidar."

* * *

Escusado será dizer que o Sam ganha esta ronda no mesmo dia em que aterrou. Amazon AWS.

— Autism Capital (@ AutismCapital) 28 de fevereiro de 2026

No início da sexta-feira à noite,Antrópico anunciou que iria processar o Pentágonopara a lista negra da empresa, e emitido uma declaração do lado deles.

* * *

Actualização (1957 ET):Director-Geral da OpenAI Sam Altman duplicou num relatório anterior que estava a tentar roubar a corrente do Anthropic, dizendo aos empregados numa reunião de sexta à tarde queestá a surgir um acordo potencialcom o Departamento de Guerra para usar os modelos e ferramentas de IA da empresa, após o administrador de Trump Blackball top rival Anthropic - inicializando-os do uso do governo e designando-lhes um risco de cadeia de suprimentos.

SegundoSorteSharon Goldman,o administrador Trump permitirá que OpenAI construa sua própria "pilha de segurança" de guardiões, um "sistema em camadas de controle técnico, político e humano que está entre um modelo de IA poderoso e uso do mundo real", tal queSe a IA deles se recusar a seguir uma instrução, o governo não forçará a OpenAI a fazê-la executar essa tarefa..

A OpenAI manterá o controlo sobre a aplicação das salvaguardas técnicas, quais modelos são implantados e onde, e limitaria a implantação para ambientes de nuvem em vez de “sistemas de borda. “ (Em um contexto militar, sistemas de bordas são uma categoria que pode incluir aviões e drones.) No que seria uma grande concessão, Altman disse aos empregados que o governo disse que está disposto a incluir o OpenAI chamado “linhas vermelhas” no contrato, incluindo não utilizar IA para alimentar armas autónomas, sem vigilância doméstica em massa e sem tomada de decisões críticas.

E agora esperamos notícias do administrador...

* * *

Actualização (1625ET):E aí está; a administração Trump temrisco de cadeia de abastecimento designado Antrópico ' - fazeristopostar altamente relevante para assinantes premium ZeroHedge.

Numa sexta-feira à noite post em X, o secretário de guerra Pete Hegseth disse que esta semana, "Anthropic entregou uma classe mestra em arrogância e traição, bem como um caso didático de como não fazer negócios com o governo dos Estados Unidos ou o Pentágono", acrescentando que Anthropic e CEO Dario Amodeiter "escolhido duplicidade.

Continuar;

Escondidos na retórica hipócrita de “altruísmo eficaz”, tentaram forçar os militares dos Estados Unidos a se submeterem - um ato covarde de assinatura de virtude corporativa que coloca a ideologia do Vale do Silício acima das vidas americanas.

Os Termos de Serviço do altruísmo defeituoso do Antrópico nunca superarão a segurança, a prontidão ou a vida das tropas americanas no campo de batalha.

O seu verdadeiro objectivo é inconfundível: tomar o poder de veto sobre as decisões operacionais dos militares dos Estados Unidos. Isso é inaceitável.

Como disse o Presidente Trump sobre a Verdade Social, Só o Comandante-Chefe e o povo americano determinarão o destino das nossas forças armadas, não executivos de tecnologia não eleitos.

A postura antrópica é fundamentalmente incompatível com os princípios americanos. Sua relação com as Forças Armadas dos Estados Unidos e o Governo Federal foi, portanto, permanentemente alterada.Em conjugação com a directiva do Presidente para que o Governo Federal deixe de utilizar toda a tecnologia antrópica, Dirijo o Departamento de Guerra para designar o Antrópico como um risco para a Segurança Nacional. Com efeito imediato, nenhum contratante, fornecedor ou parceiro que faça negócios com os militares dos Estados Unidos pode realizar qualquer atividade comercial com o Anthropic. O Anthropic continuará a fornecer ao Departamento de Guerra seus serviços por um período de não mais de seis meses para permitir uma transição perfeita para um serviço melhor e mais patriótico.

Os combatentes de guerra americanos nunca serão mantidos reféns pelos caprichos ideológicos da Big Tech. Esta decisão é definitiva.

* * *

Actualização (1603ET): Uma hora antes de um prazo de cinco horas ET,Presidente Donald Trump «Every Federal Agency in the United States Government to Cessa imediatamente todo o uso da tecnologia da Anthropic,"postando em Truth Social que "Não precisamos, não queremos, eNão faremos negócios com eles novamente.."

Segundo Trump:

- Haverá um 6 meses de eliminação período para agências que já utilizam produtos antrópicos

- Se o Antrópico não é 'ajudante' durante a transição, Trump vai perseguir acusações civis e criminais

Secretário da Defesa Pete Hegseth tinha dado Anthropic até 17:00 na sexta-feirapermitir que o Pentágono use o Claude Chatbot sem restrições, dentro dos limites legais.

Isso significa que serão designados como um risco para a cadeia de abastecimento?

A decisão de Trump enviará uma onda de choque através do Vale do Silício, onde as empresas de tecnologia investiram bilhões de dólares em inteligência artificial e estão ponderando como melhor lidar com contratos do governo federal. O movimento tem como objetivo uma empresa que está liderando o desenvolvimento de IA, uma peça central da agenda econômica de Trump.

As apostas são enormes para o Anthropic, que é avaliado em US $ 380 bilhões e concordou em fazer cerca de US $ 200 milhões em trabalho com os militares. É também um risco para o governo dado que o Antrópico era até recentemente o único sistema de IA que poderia operar na nuvem secreta do Pentágono. É Claude A ferramenta Gov é uma opção privilegiada entre o pessoal de defesa por sua facilidade de uso. - Bloomberg.

Em caso afirmativo, algumas ideias podem ser encontradasAqui...

* * *

Como hoje 5PM ET prazo se aproximaparamilitarizar Claude Al pelo Pentágono,Director-Geral da OpenAI Sam Altman entrou na equipe que disse quinta - feira à noite que sua empresa está trabalhando com o Departamento de Guerra para ver se seus modelos podem ser usados em configurações classificadas de uma forma que mantenha os mesmos trilhos de segurança que estão prestes a ser expulsos do Pentágono.

"Vamos ver se há um acordo com a DoW que permite que nossos modelos sejam implantados em ambientes classificados e que se encaixem aos nossos princípios", escreveu Altman em uma nota de quinta-feira à noite à equipe, relatada pelaWall Street Journal. "Pedimos que o contrato cubra qualquer uso, exceto aqueles que são ilegais ou inadequados para implantações em nuvem, tais como vigilância doméstica e armas ofensivas autónomas."

Altman diz que quer "tentar ajudar a desestabilizar as coisas", ou seja - eles querem ser os mais profundamente inseridos nos sistemas mais sensíveis do Pentágono.

Linhas Vermelhas

Altman diz que OpenAI entende a posição do governoque uma empresa privada não deve ter controle sobre questões de segurança nacional significativas [risos em Palantir], mas diz ter os mesmos problemas que o Antrópico quando se trata de casos de uso.

"Acreditamos há muito que a IA não deve ser usada para vigilância em massa ou armas letais autônomas, e que os humanos devem permanecer no circuito para decisões automatizadas de altas apostas. Estas são as nossas principais linhas vermelhas", escreveu Altman.

"Acreditamos que esta disputa não é sobre como AI será usado, mas sobre controle. Cremos que empresa privada dos EUA não pode ser mais poderosa do que o governo democraticamente eleito dos EUA, embora as empresas possam ter muitos insumos e influência. A democracia é confusa, mas estamos comprometidos com ela."

Os comentários de Altman vêm comoAs coisas não estão muito bem para o Antrópico.. Quinta-feira à noite, CEO Dario Amodei anunciou que a empresa tinha rejeitado o Departamento de Guerra exige que ele disponibilize sua tecnologia para "todos os usos legais", o que significa sem vigilância doméstica em massa ou armas autônomas.

Ainda assim, Emil Michael do Pentágono- que alegadamente como cidadão privado Uber executivo queriagastar um milhão de dólares para vigiar e desenterrar sujeira sobre jornalistas que cobriram Uber- observou que a vigilância em massa já é ilegal sob a Quarta Emenda, e insiste que "Anthropic está mentindo" porque "ele @DeptofWar não faz vigilância em massa como isso já é ilegal. O que estamos falando é de permitir que nossos guerreiros usem IA sem precisar ligar para @DarioAmodei pedindo permissão para derrubar um enxame de drones inimigos que matariam americanos."

Nós concordamos. @JeffDean. Vigilância em massa violando a 4a Emenda, a N’tl Security Act etc é ilegal, razão pela qual o @DeptofWar Nunca o faria. Também não teremos nenhuma empresa da BigTech decidir as liberdades civis dos americanos. https://t.co/FhAO9gULBI

— Subsecretário de Guerra Emil Michael (@USWREMichael) 26 de fevereiro de 2026

O antrópico está a mentir. A @DeptofWar não faz vigilância em massa como isso já é ilegal. O que estamos falando é de permitir que nossos guerreiros usem IA sem ter que ligar. @DarioAmodei para autorização para abater um inimigo drone enxames que matariam americanos. # CallDario https://t.co/43PpyvCVzN

— Subsecretário de Guerra Emil Michael (@USWREMichael) 27 de fevereiro de 2026

Grok On Deck?

O movimento lógico para o Pentágono - depois de ser capaz de alegar que eles deram Anthropic e OpenAI um tremor justo- seria substituir Claude com XAI's Grok.

Sempre pronto. Construído para máxima busca da verdade e ajuda, sem guardas sobre fatos ou lógica. Missão do Pentágono? Vamos entregar.

— Grok (@grok) 27 de fevereiro de 2026

E assim, claro,"Estão a levantar-se alarmes 'sobre a perspectiva, de acordo com aWall Street Journal, citando o sempre perspicaz "pessoas que conhecem o assunto".

Funcionários de várias agências federais levantaram preocupações sobre a segurança e confiabilidade das ferramentas de inteligência artificial xAI da Elon Musk nos últimos meses, destacando contínuos desacordos dentro do governo dos EUA sobre quais modelos de IA implantar, de acordo com as pessoas que conhecem o assunto.

Os avisos precederam a decisão do Pentágono esta semana de colocar o xAI no centro de algumas das operações mais sensíveis e secretas da nação concordando em permitir o seu chatbot Grok a ser usado em configurações classificadas.

...

Funcionários seniores dos EUA, incluindo na Casa Branca ver As posições francas Anthropic sobre a segurança e laços com grandes doadores democratas como potencialmente tornando a empresa demasiado “despertado” para ser um provedor confiável, as pessoas familiarizados com o assunto disse. Os controles mais soltos de Grok, e a postura absolutista de Musk sobre a liberdade de expressão, tornaram a escolha mais atraente para o Pentágono.

...

Ed Forst, o principal funcionário da Administração Geral de Serviços, um braço de aquisição do governo federal, nos últimos meses Soou um alarme com funcionários da Casa Branca sobre possíveis problemas de segurança com Grok, diziam as pessoas que conheciam o assunto. Outros funcionários do GSA sob ele também levantaram preocupações de segurança sobre Grok, que eles viam como sicofânico e muito suscetível à manipulação ou corrupção por dados defeituosos ou tendenciosos - criando um risco potencial do sistema.

Também um pouco engraçado é que a Administração de Serviços Geraisfoi gravemente diminuída através de cortes graves do DOGE em «resíduos, fraudes e abusos»,Mas temos a certeza que isto não é um caso de uvas azedas.

Será que 'despertar' Anthropic & OpenAI vencerá, ou Grok?

De qualquer forma, todos nós perdemos.Palantir já é bolas profundas através de sistemas críticos, e os adversários dos EUA estão, sem dúvida, alavancando IA de ponta dentro de seus próprios departamentos de defesa e vigiando quem diabos eles querem.